X院 · 新闻 | 大模型+运筹学=?上财叉院博士黄晨宇用ORLM论文交出全球管科领域首个顶刊答案

2025年4月,上海财经大学交叉科学研究院二年级博士生黄晨宇以第一作者身份,与上海交通大学、香港中文大学(深圳)、杜克大学、哥伦比亚大学等单位组成的联合研究团队,的研究成果《ORLM: A Customizable Framework in Training Large Models for Automated Optimization Modeling》被管理科学领域国际顶级期刊《Operations Research》正式接收,该论文是第一篇被《Operations Research》接收关于大语言模型的研究工作。

本研究首次提出一个基于开源大语言模型的自动化优化建模框架,具备高度可定制性。该框架使得经过训练的小型模型在优化建模任务中表现优于包括GPT-4在内的先进商业模型,不仅显著提升建模效率,还能有效应对工业界对数据隐私的严苛要求,为运筹优化在实际场景中的快速落地与发展提供了新的技术路径。

作为成果之一,研究团队还开源了首个面向优化建模的大语言模型ORLM,为该领域构建了一个具有广泛适应性的模型生态基础。这一举措不仅推动了优化建模技术的普惠化,也为学术界与产业界提供了重要的参考范式与实验平台,具有深远的生态影响力。

优化建模与求解是运筹学在实际应用中的核心环节。然而,传统优化建模高度依赖人工专家的经验,存在成本高昂、效率低下和泛化能力差等问题。近年来,大语言模型(LLM)的迅猛发展为优化建模的自动化带来了全新机遇。然而,现有研究多基于闭源的商业模型(如GPT-4),在数据隐私保护、模型可控性与灵活性、以及训练数据的可获取性等方面面临诸多挑战,限制了其在运筹学领域的有效应用和深入落地。

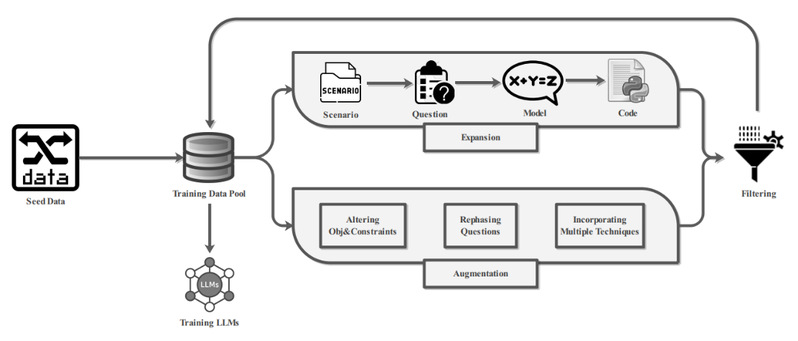

为突破上述瓶颈,本文首次提出了一种创新的、可定制化的开源大语言模型训练框架,专为优化建模任务设计。该框架支持对开源大模型进行领域定制训练,显著提升了模型在自动化建模与求解方面的能力。在训练数据有限的背景下,作者还原创性地提出了一个半自动化的数据生成方法——OR-Instruct。该方法结合扩展策略(Expansion)与增强策略(Augmentation),两者均受启发于算法工程师在优化建模实践中的专业策略,有效缓解了高质量标注数据匮乏的问题,为大模型在运筹优化领域的实际部署提供了坚实的数据支撑。

此外,研究团队还首次构建了一个工业级优化建模基准数据集——IndustryOR,涵盖13个不同行业与5类典型问题类型(包括线性、整数、混合整数、非线性及其他),并设有多级难度划分。相较于现有如NL4OPT等结构单一的数据集,IndustryOR在多样性与现实性方面具有显著优势,为未来优化建模模型的评估提供了更全面、严格且贴近实际的测试环境。

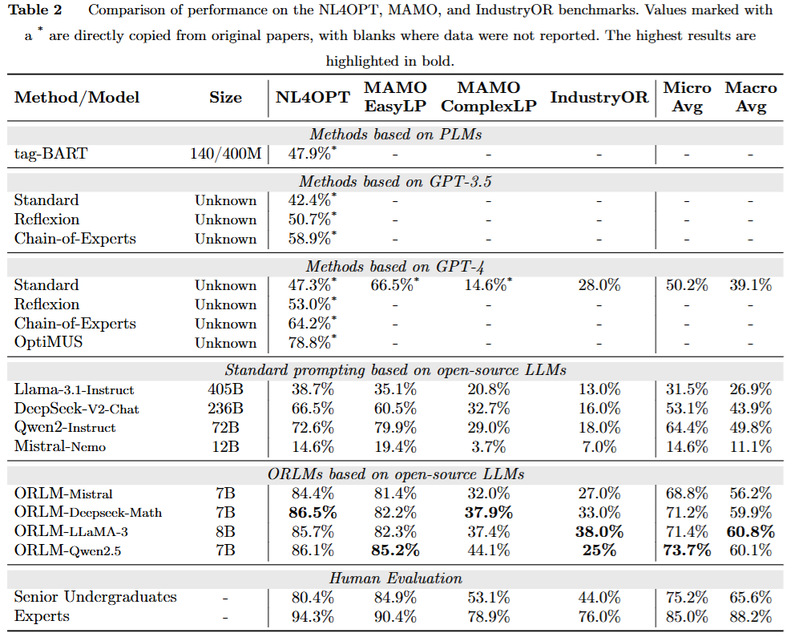

研究团队进一步基于所提出的OR-Instruct方法,共合成约32,481条高质量训练样本,并对多个开源大语言模型(如Mistral-7B、Deepseek-Math-7B、LLaMA-3-8B等)进行了定向微调,构建出一系列专用于优化建模任务的开源模型,统称为ORLMs。实验结果表明,ORLMs在多个公开基准数据集(包括NL4OPT、MAMO与IndustryOR)上的表现均显著优于主流闭源模型(如GPT-4)及其他开源大模型,达到了当前该领域的最先进水平。本研究还系统探讨了模型规模(scaling law)与推理设置(inference setting)对优化建模性能的影响,揭示了模型参数规模、温度参数等关键因素在自动化优化建模中的作用机制与性能边界。此外,研究成果进一步验证了强化学习(Reinforcement Learning)技术在提升大语言模型优化建模能力方面的潜力,展示了其在优化建模任务中引导模型生成高质量结构化输出的有效性与广阔应用前景。

作为首个开源的运筹学大语言模型,ORLM的诞生标志着运筹学从依赖专家经验的传统建模范式,迈向自动化与智能化的新阶段。通过对开源大语言模型(LLMs)进行定向训练,ORLM显著降低了对人类专家的依赖,使运筹优化技术更易于在工业界和学术界广泛部署与应用。这一自动化建模能力不仅显著提升了建模效率,还有效降低了技术门槛,使更多企业能够借助运筹学手段优化决策流程,实现降本增效的目标。

未来,随着模型性能的持续优化与基准数据集的进一步扩展,ORLM有望在供应链优化、能源管理、医疗资源配置等多个关键领域取得实质性突破。同时,ORLM所构建的开源生态也为学术研究提供了宝贵的平台资源,推动运筹学与人工智能的深度融合,开辟了智能优化领域的新路径。

论文地址:https://arxiv.org/pdf/2405.17743

数据地址:https://huggingface.co/datasets/CardinalOperations/OR-Instruct-Data-3K

IndustryOR地址:https://huggingface.co/datasets/CardinalOperations/IndustryOR

开源模型地址:https://huggingface.co/CardinalOperations/ORLM-LLaMA-3-8B

代码地址:https://github.com/Cardinal-Operations/ORLM

微信号|SUFE_RIIS

扫描二维码 关注我们

RIIS

RESEARCH INSTITUTE for INTERDISCIPLINARY SCIENCES